Vamos deambulando por un camino sinuoso a través de una tierra de incógnitas, y cada paso nos conduce a lo más profundo de un mundo donde cada giro encierra tanto promesas como peligros.

En esta búsqueda, los riesgos no son algo con lo que uno se topa por casualidad, sino que surgen de repente, a veces camuflados en sesgos sutiles, otras veces haciendo alarde de sus peligros a plena luz del día. Es un paisaje lleno de peligros impredecibles, y reconocerlos es solo el comienzo. La verdadera supervivencia aquí exige algo más que conciencia: requiere un mapa.

A primera vista, los peligros parecen dispersos, pero al observar más de cerca, comienzan a surgir patrones. La discriminación y la toxicidad se imponen como monstruos familiares en el camino. Ocultos en los algoritmos, los sesgos pueden distorsionar los resultados, dejando a las personas a un lado por características como la raza o el género, sin que nadie se dé cuenta hasta que es demasiado tarde. Es como si la IA hubiera recogido los prejuicios que hemos dejado a nuestro alrededor y los hubiera amplificado, moldeando el mundo de maneras que reflejan lo peor de nosotros. Pero luego, está el espectro inminente de la privacidad y la seguridad: las puertas que se suponía debían proteger los datos confidenciales ahora están comprometidas o, peor aún, abiertas de par en par para que actores maliciosos las crucen. El camino no solo está lleno de criaturas hostiles; es vulnerable a invasores que se cuelan sin ser detectados, tomando lo que quieren y sembrando el caos.

Sigue caminando y te encontrarás con algo aún más difícil de manejar: la desinformación. Ya sea que provenga de sistemas de IA descontrolados o de una intromisión intencionada, tiene el poder de transformar la realidad. Como un mago que distorsiona la verdad, la desinformación generada por la IA puede distorsionar la percepción pública, influir en las decisiones e incluso cambiar el curso de los acontecimientos del mundo real. Crees tomar una decisión basada en hechos, pero estos se han sustituido por ingeniosas ilusiones. Las consecuencias se extienden, perturbando a las sociedades, desviando las conversaciones y, a veces, provocando conflictos donde antes no existían.

Y no acaba ahí. Incluso cuando los sistemas de IA parecen funcionar bien, su interacción con los humanos puede volverse turbia. Podrías encontrarte confiando demasiado en sus sugerencias, y la línea entre el juicio humano y la entrada de las máquinas se difumina con cada paso. Esta dependencia excesiva no es solo un problema individual; influye en las decisiones a niveles superiores, ya sea en los negocios, la salud o la gobernanza, lo que genera dilemas éticos y una erosión gradual de la capacidad de acción humana. Es como si, cuanto más avanzas, más tentador se volviera dejar que la IA tomara las riendas, mientras tú te quedas sentado y asumes que ella sabe más.

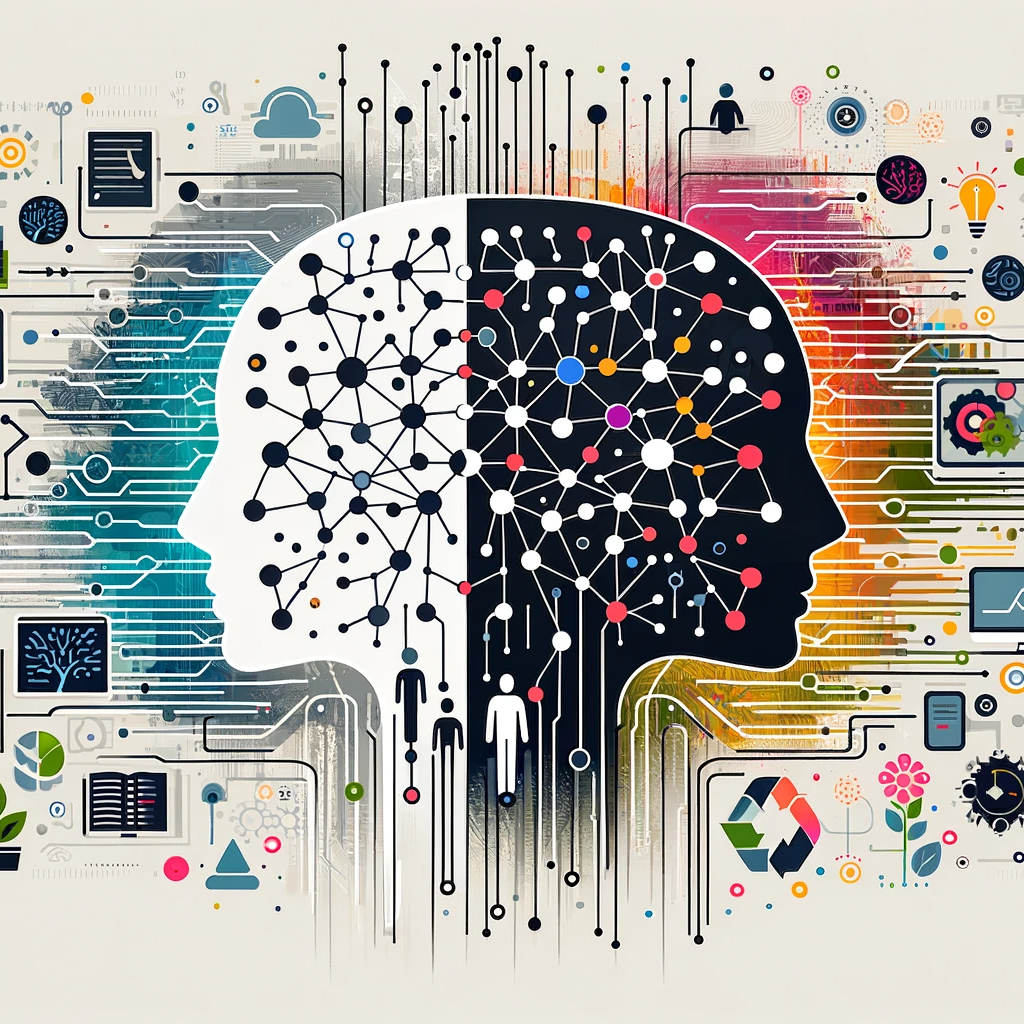

El verdadero truco aquí no es sólo esquivar estos peligros uno por uno, sino aprender cómo se conectan, cómo se multiplican y se amplifican entre sí de maneras que a menudo no esperamos. La discriminación no tiene que ver sólo con el trato injusto: está vinculada a la privacidad cuando los sistemas de inteligencia artificial perfilan a las personas de maneras que violan su espacio personal. La desinformación no sólo distorsiona la verdad, sino que explota esos mismos sesgos, alimentándose de nuestras peores suposiciones. Todo el viaje está interconectado, una red de riesgos que no se divide claramente en categorías, sino que se extiende a través de dominios, influyendo en la gobernanza, las normas sociales e incluso nuestras libertades individuales.

Entonces, ¿cómo podemos abordar esta situación? El primer paso es crear ese mapa, una taxonomía de los riesgos de la IA que no sea solo una lista sino una red. No se trata solo de categorizar los riesgos, sino de comprender sus relaciones y anticipar cómo podrían evolucionar. Este marco ayuda a los responsables de las políticas, los desarrolladores y los usuarios no solo a ver el panorama, sino también a comprender cómo podría cambiar bajo sus pies, ofreciendo una forma de diseñar estrategias para enfrentar los peligros antes de que se vuelvan demasiado grandes para manejarlos y se puedan ver. aquí en Inglés.

Pero trazar un mapa de los peligros es sólo el principio. Este camino requiere una vigilancia constante. A medida que la tecnología avanza, los riesgos se transforman. Se abren nuevos caminos y, con ellos, aparecen nuevos peligros. No podemos permitirnos seguir un mapa estático, rígido e inmutable. En cambio, es esencial realizar un seguimiento continuo, adaptando nuestras evaluaciones de riesgos al panorama en constante cambio de la tecnología y su intersección con la sociedad. Se trata de mantenerse a la vanguardia, predecir dónde podrían surgir los próximos riesgos y prepararse para ellos antes de que tengan la oportunidad de desviarnos del rumbo.

En definitiva, navegar por este paraíso de la IA no es un viaje en solitario, sino un esfuerzo colaborativo que involucra a todos, desde los creadores de sistemas de IA hasta los usuarios, los reguladores y la sociedad en general. Cada grupo desempeña un papel en el trazado del rumbo a seguir, garantizando que el desarrollo y la implementación de tecnologías de IA se alineen no solo con las posibilidades técnicas, sino también con las consideraciones éticas y sociales. A medida que el panorama evoluciona, debemos evolucionar con él, manteniendo un equilibrio cuidadoso entre innovación y precaución, entre potencial y protección.

Así, mientras recorremos juntos este camino, con los ojos bien abiertos a los riesgos y oportunidades que tenemos por delante, reconocemos que el futuro de la IA no se trata solo de construir mejores sistemas, sino de construir una mejor forma de coexistir con ellos, garantizando que el país de las maravillas que creemos sea uno en el que podamos prosperar, en lugar de uno que amenace con consumirnos por completo mientras recorremos el camino.